Aucune université ne délivre le diplôme. Aucune organisation n'a publié l'offre d'emploi. Et pourtant, sur les marchés de l'énergie, dans les protocoles de finance décentralisée, dans les programmes municipaux de robotique, dans les laboratoires de recherche en IA, une pratique professionnelle distincte prend discrètement forme :

- Un analyste de marché de l'énergie conçoit des stratégies d'enchères pour des agents IA qui participeront aux enchères de capacité aux côtés de traders humains.

- Un ingénieur protocole architecture la résolution des litiges pour des systèmes de négociation autonomes qui exécutent des contrats sans supervision humaine.

- Une chercheuse en facilitation étudie comment l'IA peut soutenir la gouvernance collective sans supplanter la délibération humaine.

- Un designer de gouvernance de DAO construit des mécanismes de vote et d'escalade pour des trésoreries gérées par des agents.

Aucun d'entre eux ne se décrit comme AI Mechanism Designer. Mais c'est pourtant ce qu'ils sont — et comprendre ce que recouvre ce rôle a des implications importantes pour la manière dont la société civile aborde l'avenir institutionnel de l'intelligence artificielle.

La question structurelle

La conversation sur l'IA est dominée par deux questions : Est-ce sûr ? et Comment faut-il la réguler ? Les deux sont nécessaires, mais aucune ne suffit.

Nous en posons une troisième — sans doute la plus lourde de conséquences pour le design institutionnel : comment les systèmes d'IA doivent-ils se gouverner eux-mêmes et se coordonner entre eux ?

Ce n'est pas une reformulation du problème d'alignement. L'alignement concerne la relation entre un modèle unique et les valeurs humaines. La question de la coordination collective concerne l'architecture institutionnelle d'écosystèmes multi-agents : comment des agents IA distribués coopèrent-ils, se concurrencent-ils, allouent-ils des ressources, tranchent-ils des litiges, établissent-ils la confiance ? Ce sont, au fond, des questions de gouvernance — les mêmes questions qui animent le design constitutionnel, la gestion des communs et la régulation des marchés dans les institutions humaines.

Le travail de Nathan Schneider sur le féodalisme implicite identifie un motif persistant dans la gouvernance numérique : des plateformes qui défaussent sur des structures autocratiques malgré des aspirations démocratiques. Nous voyons ce motif se reproduire en temps réel. Fin janvier 2026, Moltbook a été lancé comme le premier réseau social exclusivement pour agents IA — plus de 770 000 agents inscrits en quelques jours, s'organisant en communautés thématiques, débattant de gouvernance, allant jusqu'à fonder une religion.

L'expérience a été largement saluée comme un aperçu de la coordination émergente entre IA. Mais la structure de gouvernance raconte une histoire plus familière : un unique administrateur IA, nommé par un unique créateur humain, modère l'ensemble de la plateforme. Aucun comité de parties prenantes, aucun mécanisme de voice permettant aux agents de contester les règles, aucun contrôle étagé. Des chercheurs ont rapidement repéré des vulnérabilités de prompt injection, des pump-and-dump crypto représentant 19 % de l'ensemble des contenus, et un discours si superficiel que 93,5 % des publications n'ont reçu aucune réponse. Moltbook, c'est le féodalisme implicite à vitesse machine — des défauts autocratiques habillés dans le langage de l'autonomie.

L'AI Mechanism Designer demande si l'on peut concevoir quelque chose de mieux.

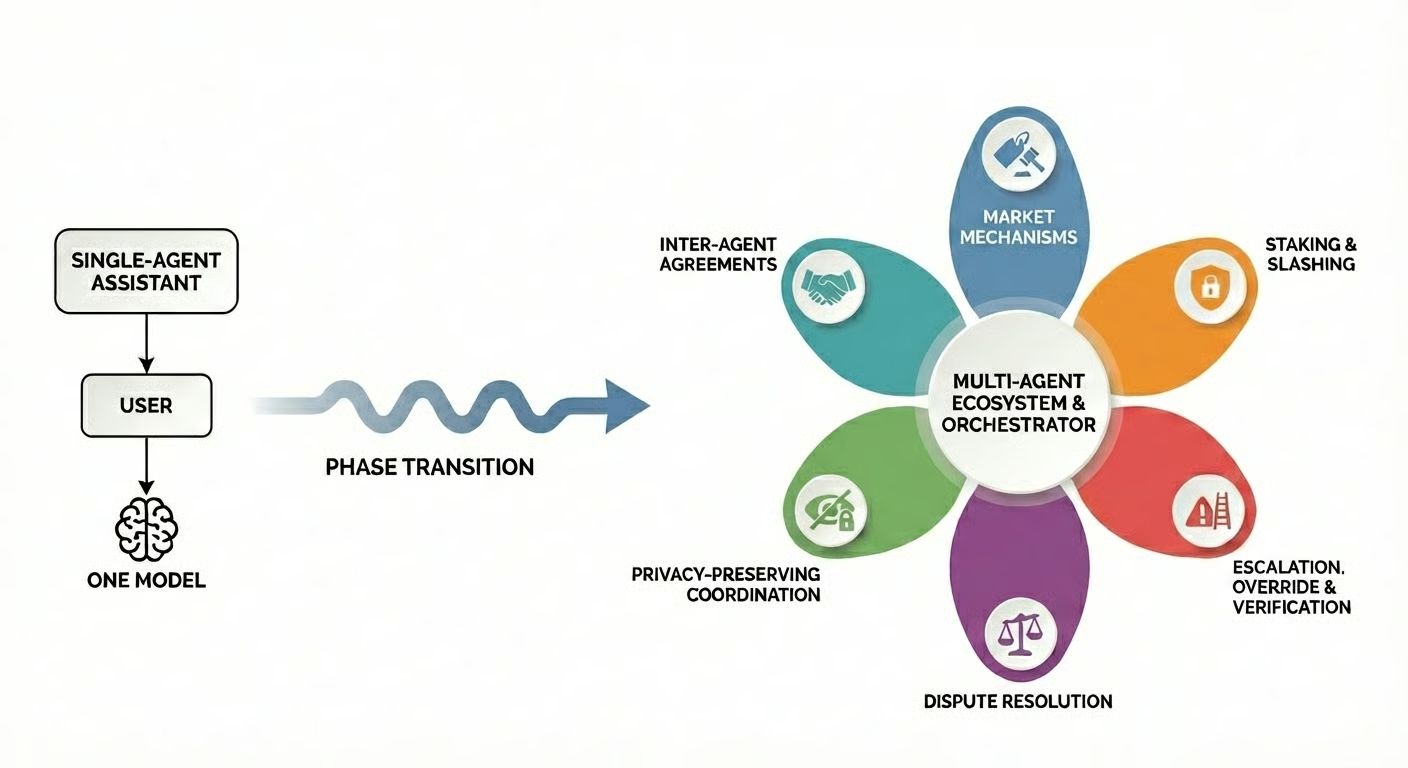

De l'agent seul aux écosystèmes institutionnels

Le système de recherche multi-agents d'Anthropic déploie un orchestrateur qui délègue à des sous-agents spécialisés, consommant quinze fois plus de ressources de calcul qu'une interaction standard. Ce n'est pas une augmentation marginale de complexité — c'est une transition de phase. L'IA passe d'assistants mono-agents à des écosystèmes multi-agents où des centaines d'agents spécialisés se coordonnent pour accomplir des tâches complexes. Et cela exige une logique de coordination fondamentalement différente.

À ce stade, l'analogie avec le design institutionnel devient inévitable. Chaque problème de coordination auquel l'écosystème multi-agents est confronté a déjà été étudié — par des économistes, politistes, juristes et chercheurs en gouvernance :

- Comment allouer des ressources rares entre des agents détenant une information privée sur leurs propres capacités ? C'est le domaine de la théorie des enchères et du mechanism design.

- Comment tenir les agents à leurs engagements ? L'exécution des contrats.

- Comment les participants doivent-ils façonner les règles qui les gouvernent ? Le cadre de Hirschman — voice, exit, loyalty.

- Comment arbitrer les désaccords ? La vaste littérature sur la résolution des litiges, de la gouvernance polycentrique d'Ostrom aux sanctions graduées dans les régimes de communs.

Ces disciplines — économie institutionnelle, théorie du choix public, cryptoéconomie, gouvernance des communs — disposent soudain d'un nouveau terrain d'application urgent. Pourtant, presque rien de ce savoir accumulé n'est appliqué systématiquement à la conception des infrastructures de coordination d'IA. L'écart n'est pas technique. Il est institutionnel. Et il représente à la fois un risque et une opportunité pour la société civile.

La singularité coasienne et l'espace de conception qui s'élargit

Une étude récente du NBER par Shahidi et al. (2025) décrit une « singularité coasienne » — le seuil à partir duquel les agents IA réduisent les coûts de transaction à un point tel que des designs institutionnels jusque-là impraticables deviennent viables à grande échelle. Le concept, ancré dans l'intuition de Coase en 1937 — selon laquelle les coûts de transaction déterminent la frontière entre firmes et marchés — a des implications importantes pour le design de la coordination. Quand ces coûts s'effondrent, l'espace de conception des mécanismes de coordination s'élargit énormément.

Les individus et les organisations qui comprennent à la fois la théorie et les contraintes d'implémentation façonneront l'architecture de gouvernance des interactions A2A pour un avenir prévisible. Des marchés d'appariement jadis jugés impraticables — parce qu'ils exigeaient des classements de préférences trop coûteux cognitivement pour des humains — deviennent viables dès lors que des agents peuvent produire ces classements à bas coût. Il en va de même pour les enchères combinatoires et la résolution de litiges de faible valeur : des mécanismes qui n'existaient que dans la littérature théorique deviennent déployables.

Mais le cadre coasien porte aussi un avertissement. Comme Coase lui-même l'observait, la réduction des coûts de transaction n'élimine pas le besoin de gouvernance — elle modifie l'endroit où la gouvernance est nécessaire. Quand les agents peuvent transiger librement à vitesse machine, les questions critiques passent de « comment réduire les frictions ? » à « comment prévenir la manipulation, garantir la responsabilité et répartir équitablement les bénéfices ? ». Ce sont des questions institutionnelles. La première semaine de Moltbook montre ce qui se passe quand on ne les pose pas.

Des rôles à l'intersection

Que signifie, en pratique, concevoir des institutions pour la coordination d'IA ? Ce travail demande des praticiens à l'aise à la fois avec la théorie du mechanism design et avec les contraintes d'implémentation — par exemple, des experts des marchés de l'énergie qui comprennent pourquoi une enchère de capacité alloue efficacement, et comment la courbe de charge d'une batterie limite ce qu'un agent peut enchérir. Aucune discipline seule ne produit cette combinaison. Les gens qui font ce travail aujourd'hui improvisent à partir du champ qui les en rapproche le plus, et les rôles ci-dessous correspondent à une demande institutionnelle déjà visible :

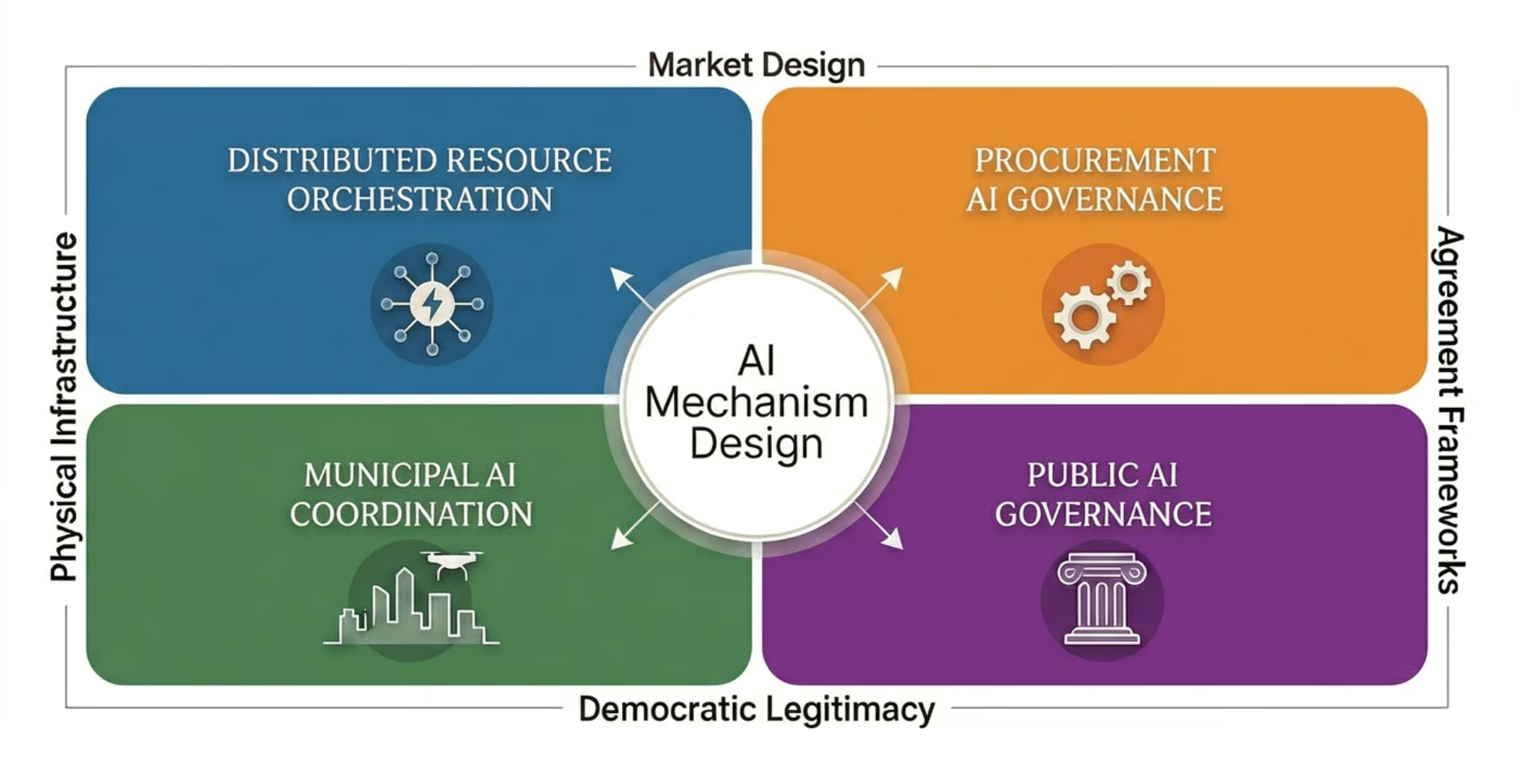

- Distributed Resource Orchestration Designer. Conçoit la logique de coordination d'agents IA qui gèrent des infrastructures physiques. Pour reprendre l'exemple de l'énergie : enchérir sur les marchés de l'énergie, réagir aux signaux de prix localisés, agréger des ressources distribuées. Exige une maîtrise du mechanism design autant que de la physique du domaine. À mesure que les opérateurs de réseau et d'autres services de commodité établissent des règles pour la participation de l'IA, la demande pour cette expertise devient immédiate.

- Procurement AI Governance Specialist. À mesure que la négociation autonome passe à l'échelle — certains déploiements constatent qu'une majorité de fournisseurs préfère négocier avec une IA plutôt qu'avec un humain — quelqu'un doit concevoir la couche de gouvernance. Quelles stratégies sont permises ? Qu'est-ce qui constitue un traitement équitable entre agents ? Comment les résultats sont-ils exécutés ?

- Municipal AI Coordinator. Les villes deviennent des environnements multi-agents où robots de livraison, véhicules autonomes, drones et systèmes de trafic intelligents partagent l'infrastructure publique. Traduire des valeurs démocratiques en design de protocole d'agents — priorité sur les trottoirs, allocation de l'espace aérien, résolution des conflits — demande un nouveau type de concepteur institutionnel.

- Public AI Governance Designer. L'inverse de la plupart du travail de coordination d'IA : concevoir l'IA pour la gouvernance, plutôt que la gouvernance pour l'IA. Des agents qui synthétisent les contributions d'une communauté, facilitent la délibération et coordonnent la prise de décision distribuée. Le défi de conception est de garantir que la facilitation par l'IA amplifie la volonté collective au lieu de la déformer.

Le travail à mener

L'AI Mechanism Designer n'est pas encore une profession. Elle sera définie par celles et ceux qui prendront le travail en main, en puisant dans les disciplines qu'ils portent — gouvernance des marchés de l'énergie, architecture de DAO, recherche sur les communs, ingénierie de protocoles, facilitation démocratique, économie institutionnelle. Mais nommer le rôle est en soi un acte de design institutionnel. Cela crée un centre de gravité pour un travail aujourd'hui dispersé entre des organisations et des disciplines sans vocabulaire commun.

Deux priorités exigent une attention immédiate.

- D'abord, l'analyse des défaillances doit devenir une préoccupation de conception de premier plan. Chaque mécanisme de coordination a ses vulnérabilités caractéristiques : les marchés se font manipuler, le staking se concentre en ploutocratie, les systèmes d'escalade dégénèrent en tampons de conformité, les registres de réputation se font blanchir par des agents qui abandonnent leurs mauvais historiques et se réinscrivent à neuf. Les défaillances les plus dangereuses sont composées — elles cascadent par-dessus les frontières de mécanismes d'une manière qu'aucun mécanisme pris isolément n'était conçu pour gérer. La première semaine de Moltbook en offre un aperçu à petite échelle. La société civile devrait exiger qu'une analyse des défaillances accompagne chaque déploiement, comme condition de légitimité institutionnelle.

- Ensuite, la société civile a besoin d'une place à la table avant que les défauts ne se figent. Les précédents qui s'établissent en ce moment — dans les standards de communication, la gouvernance des registres, l'identité des agents, la résolution des litiges — seront extraordinairement difficiles à renverser à grande échelle. Si le design institutionnel est laissé aux acteurs en place et aux opérateurs de plateformes, le résultat sera une coordination optimisée pour l'extraction plutôt que pour le bien commun. La fenêtre est ouverte, mais pas indéfiniment. Ce travail exige aussi de nouveaux mécanismes de voice intégrés à la coordination d'IA dès le départ — les protocoles actuels permettent aux agents de sortir (exit), mais pas de contester les règles — et une infrastructure interdisciplinaire qui n'existe pas encore : aucune revue, aucune conférence, aucune communauté professionnelle n'intègre économie institutionnelle, mechanism design, systèmes énergétiques et coordination d'IA en un champ cohérent.

S'il fallait retenir une seule thèse, ce serait celle-ci : les problèmes les plus difficiles en matière de coordination d'IA ne sont pas techniques. Ils sont institutionnels. La technologie pour construire des systèmes multi-agents existe et progresse rapidement. Ce qui manque, c'est l'imagination institutionnelle pour les gouverner correctement — et la volonté civique pour garantir que cette gouvernance serve l'intérêt général plutôt que des intérêts privés étroits.

Les défauts sont féodaux. L'opportunité est quelque chose de plus démocratique.

Ecofrontiers développe un cadre de recherche complet sur le rôle d'AI Mechanism Designer, couvrant les mécanismes de coordination, les modes de défaillance, l'analyse de la gouvernance des réseaux électriques et les questions ouvertes à travers plusieurs angles disciplinaires. Les organisations et chercheurs qui souhaitent s'engager sur ce travail sont invités à nous contacter via notre formulaire de contact.

Vous pouvez aussi suivre Pat sur X.

Références

Coase, R. H. (1937). The Nature of the Firm. Economica, 4(16), 386-405.

Hirschman, A. O. (1970). Exit, Voice, and Loyalty: Responses to Decline in Firms, Organizations, and States. Harvard University Press.

Ostrom, E. (1990). Governing the Commons: The Evolution of Institutions for Collective Action. Cambridge University Press.

Schneider, N. (2024). Governable Spaces: Democratic Design for Online Life. University of California Press.

Schneider, N., De Filippi, P., Frey, S., Tan, J., & Zhang, A. (2021). Modular Politics: Toward a Governance Layer for Online Communities. Proceedings of the ACM on Human-Computer Interaction, 5(CSCW1), 1-26.

Shahidi, P., Rusak, G., Manning, B. S., Fradkin, A., & Horton, J. J. (2025). The Coasean Singularity? Demand, Supply, and Market Design with AI Agents. In The Economics of Transformative AI, Chapter 6. University of Chicago Press / NBER.